Qu’est-ce que l’IA ?

Introduction

|

« L’intelligence artificielle se définit comme le contraire de la bêtise naturelle ». Woody Allen |

|

« Nous entrons dans une guerre cérébrale : les cerveaux de silicium contre les cerveaux de ceux qui ont créé ces derniers ». Laurent Alexandre |

Les programmes d’intelligence artificielle actuelle ne suivent pas la logique, ou l’illogique, de l’intelligence humaine1. L’homme accède à la connaissance du monde par le biais d’un assemblage de perceptions diverses mêlant l’observation, l’impression, l’intuition, l’expérience, la référence... Son cerveau, analysé désormais par différentes techniques d’imagerie médicale, fonctionne par excitation de ces différentes zones cérébrales. Finalement nous sommes plus malins qu’il n’y paraît.

De plus, l’action de penser chez l’homme ne se réduit pas à une logique binaire, de type booléenne, combinant des zéros et des uns2. Quelle que soit la sophistication des programmes informatiques, ils sont tous fondés sur ce principe. Cependant, il est des évolutions qui sont destinées à durer et à transformer profondément notre monde ; l’intelligence artificielle (IA)...

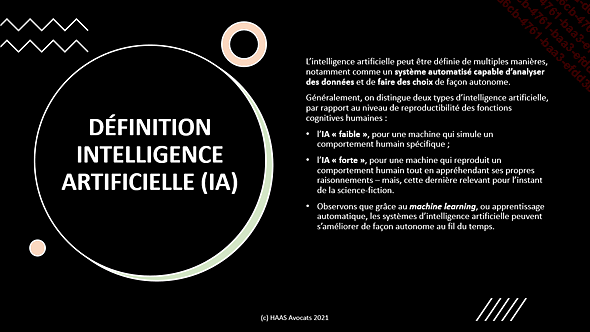

Tentative de définition

L’IA6, selon l’un de ses créateurs, Marvin Lee Minsky, l’IA est une science qui consiste à faire effectuer aux machines ce que l’homme ferait moyennant une certaine intelligence. Il la définit comme « la construction de programmes informatiques qui s’adonnent à des tâches qui sont, pour l’instant, accomplies de façon plus satisfaisante par des êtres humains, car elles demandent des processus mentaux de haut niveau tels que l’apprentissage perceptuel, l’organisation de la mémoire et le raisonnement critique ».

Notons que la norme ISO 2382-28 définit de son côté l’IA comme la « capacité d’une unitéfonctionnelle à exécuter des fonctions généralement associées à l’intelligence humaine, telles que le raisonnement et l’apprentissage ».

Autrement dit, l’IA fait apparaître quatre catégories :

-

les systèmes qui pensent comme les humains ;

-

les systèmes qui agissent comme les humains ;

-

les systèmes qui pensent de manière rationnelle ;

-

les systèmes qui agissent de manière rationnelle.

Le développement de l’IA a été rendu possible en grande partie grâce au cloud, au big data...

Courte histoire de l’IA

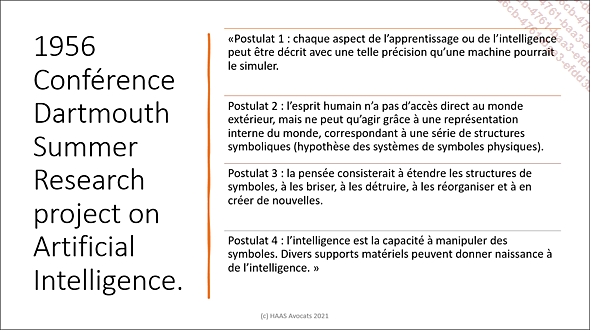

Schématiquement7, il y a quatre grandes périodes de l’IA.

La première (1960 - 2010) est constituée par les programmes traditionnels fonctionnant via des algorithmes programmés manuellement.

La deuxième, commencée vers 2012 et dans laquelle nous évoluons encore, correspond à l’ère de l’apprentissage profond (deep learning), lequel est plus affaire d’auto-éducation que de programmation, d’où le pouvoir conféré aux GAFAM détenteurs d’immenses bases de données. La performance de l’IA dans l’analyse des radiographies dépasse d’ores et déjà la capacité d’analyse humaine professionnelle d’un radiologue.

La troisième période devrait débuter à partir de 2030, et coïnciderait avec une IA capable notamment de transversalité. Avec cette troisième génération, ce sont les médecins généralistes qui à leur tour seront concurrencés.

Avec la quatrième, nous quitterons une IA faible pour pénétrer dans une IA forte, c’est-à-dire un système capable de comportements réellement intelligents, de conscience de soi, d’émotions et de compréhension de ses raisonnements. En même temps, l’IA...

L’IA va nous transformer... Une question de temps

Comme toutes les innovations technologiques, l’IA peut prendre des orientations très diverses ; c’est pourquoi il est primordial que les principes éthiques soient posés en amont des travaux scientifiques afin de les guider. En effet, notre civilisation a pris un tournant...à nous de l’accompagner et de le vivre au mieux afin de gérer d’éventuels conflits, oppositions, synergies, complémentarités, mais aussi co-évolutions.

Maîtrisée, l’IA est une formidable opportunité, mais encore faut-il que techniquement les systèmes d’IA restent sous contrôle et supervision humaine, respectent les grandes règles sur les données personnelles, s’appuient sur des algorithmes sécurisés, soient transparents, traçables, accessibles au plus grand nombre et non discriminants.

La dimension éthique de l’IA n’est pas un accessoire de luxe ou une option. La confiance dans l’IA est essentielle, car les consommateurs ne feront confiance à des systèmes d’IA qu’avec la certitude que leurs droits seront respectés et protégés. Remarquons que la valeur créée par l’intelligence artificielle provient des données nécessaires à l’apprentissage bien plus...

Une approche de l’IA par la gestion des risques

L’approche des innovations par la gestion des risques est apparue très tôt. Ainsi, en matière de robotique, Asimov10 fixait déjà en 1941 trois lois, complétées par la suite par la loi Zéro qui prévoit :

-

Loi Zéro : un robot ne peut pas porter atteinte à l’humanité ni, par son inaction, permettre que l’humanité soit exposée au danger ;

-

Première Loi : un robot ne peut porter atteinte à un être humain ni, restant passif, permettre qu’un être humain soit exposé au danger, sauf contradiction avec la Loi Zéro ;

-

Deuxième Loi : un robot doit obéir aux ordres que lui donne un être humain, sauf si de tels ordres entrent en conflit avec la Première Loi ou la Loi Zéro ;

-

Troisième Loi : un robot doit protéger son existence tant que cette protection n’entre pas en conflit avec la Première ou la Deuxième Loi ou la Loi Zéro.

Même si nous sommes encore loin du point de singularité, c’est-à-dire du moment où l’intelligence artificielle dépassera l’intelligence humaine et risque alors de vouloir s’affranchir de sa domination, l’approche de l’IA par la gestion des risques nous semble pertinente...

Un statut à trouver pour la responsabilité de l’IA faible

Le droit et son corollaire, la responsabilité, relèvent du champ de l’action humaine auquel l’intelligence artificielle est par nature exclue. Cela est certain lorsque le droit et la responsabilité sont causés par le contrat. En effet, seul un humain a la capacité de contracter et a conscience de donner un consentement libre et éclairé.

De même la responsabilité civile du fait d’une personne est, selon la loi, le prolongement de l’action humaine.

Les choses15, les animaux16, les propriétés, et dans une moindre mesure les enfants et les préposés17, ne traversent le champ du droit et de la responsabilité car l’humain est celui qui fixe les règles18.

C’est l’individu et lui seul qui est responsable et doit répondre de ses décisions19.

Il semble en effet essentiel d’appréhender l’intelligence artificielle en ce qu’elle a de singulier (interactivité, apprentissage, polyvalence et autonomie). L’enjeu est de préserver le caractère universel de la loi tout en favorisant l’éclosion d’une IA dans un espace juridiquement sécurisé20.

Dans ce contexte, l’une des principales questions posées est celle de la détermination de la responsabilité...

Notes

1 S. Russell & P. Norvig « Intelligence artificielle » Pearson 2010 ; 3e édition ; J.C. Heudin « Intelligence artificielle : manuel de survie » ; Science e-Book 2018.

2 Cf. Bruno Bonnell « Viva la révolution », JC Lattès 2010

3 Selon une étude de Boston Consulting Group et de l’institut de sondages Ipsos « Artificial Intelligence : Have No Fear ! », enquête menée auprès de 7 000 personnes à travers le monde, deux tiers des personnes qui travaillent avec l’IA estiment qu’elle a un impact positif. Pour 69 % de ces derniers, elle améliore le bien-être au travail. Concernant le panel français, s’ils pensent à 61 % que les robots peuvent améliorer l’organisation de leur entreprise, ils sont 65 % (taux le plus important) à craindre des conséquences négatives sur leur salaire. Cette vision est peut-être liée à un manque d’utilisation : les Français ne sont que 16 % à dire qu’ils travaillent dans un environnement où l’IA est déjà utilisée, contre 22 % en moyenne et... 31 % en Chine, premier devant le Canada (26 %) et les Etats-Unis (24 %). www.bcg.com.

4 Soulignons que dans son ouvrage « La guerre des intelligences », Laurent Alexandre soutient que nous sommes dans une ère de la colonisation numérique principalement menée par les GAFAM (Google Amazon Facebook Microsoft) et les BATX (Baidu Alibaba Tencent Xiaomi) et ces organisations nous ont confisqué tout débat numérique, un phénomène dont il est temps de prendre conscience.

5Cf. Kai-Fu Lee « IA, la plus grande mutation de l’histoire » (Les Arènes) : dans ce livre majeur, l’auteur raconte comment la Chine rattrape non seulement son retard sur la Silicon Valley, mais va peut-être bientôt la surpasser. Surtout, il montre à quel point l’IA s’apprête à bouleverser...

Editions ENI Livres | Vidéos | e-Formations

Editions ENI Livres | Vidéos | e-Formations