L'avancée des modèles GPT et leurs alternatives

De GPT à GPT-4o mini : évolution et innovations

GPT (2018) : le modèle initial de la série

Le modèle GPT (Generative Pre-trained Transformer), introduit par OpenAI en 2018, a marqué une étape importante dans le domaine de l’intelligence artificielle et du traitement du langage naturel. Ce modèle initial a posé les bases de la génération de texte basée sur des réseaux de neurones, ouvrant la voie à une nouvelle ère dans la compréhension et la production automatique du langage.

Caractéristiques principales de GPT :

-

Architecture Transformer : GPT a utilisé l’architecture Transformer, initialement développée pour la traduction automatique, en se concentrant sur la partie décodeur. Cette approche a permis une meilleure capture des dépendances à long terme dans le texte.

-

Pré-entraînement génératif : le modèle a été pré-entraîné sur un vaste corpus de textes non étiquetés, lui permettant d’apprendre les structures et les patterns du langage naturel.

-

Fine-tuning pour des tâches spécifiques : après le pré-entraînement, GPT pouvait être affiné pour diverses tâches de traitement du langage naturel, démontrant une grande polyvalence.

-

117 millions de paramètres : bien que modeste par rapport aux standards actuels (modèles allant de 3 milliards pour les plus petits à plus de 1000 milliards pour les plus grands), ce nombre de paramètres était considérable à l’époque et permettait déjà des performances impressionnantes.

-

Capacité de génération de texte cohérent : GPT a montré une capacité à générer du texte cohérent et contextuel, ouvrant la voie à de nombreuses applications pratiques.

L’introduction de GPT en 2018 a jeté les bases des futures itérations du modèle, chacune apportant des améliorations significatives en termes de taille, de capacités et de performance. Ce modèle initial a démontré le potentiel des approches basées sur le pré-entraînement à grande échelle...

Gemini : le géant Google a fait fort

Gemini 1.0

Le 6 décembre 2023 restera gravé dans l’histoire de l’intelligence artificielle comme le jour où Google dévoila au monde Gemini 1.0 Pro, la première itération majeure de sa série révolutionnaire Gemini. Ce lancement ne représentait pas simplement l’introduction d’un nouveau modèle de langage, mais marquait le début d’une nouvelle ère dans la course à l’IA générative.

Positionné stratégiquement entre le modèle léger Gemini Nano et la puissante version Ultra, Gemini 1.0 Pro se présentait comme la solution intermédiaire idéale, alliant performance et accessibilité. Ses capacités de compréhension et de raisonnement avancées lui permettaient de naviguer avec aisance à travers des chaînes de raisonnement complexes et prolongées, ouvrant ainsi la voie à des applications jusqu’alors inimaginables.

Les premières études comparatives ne tardèrent pas à démontrer la supériorité de Gemini Pro face à ses concurrents, notamment GPT-3.5 d’OpenAI, sur certaines tâches spécifiques. Cette performance n’était pas passée inaperçue dans la communauté scientifique et technologique, suscitant un vif intérêt et de grandes attentes.

Google, conscient du potentiel de sa création, rendit rapidement Gemini 1.0 Pro accessible via son API sur les plateformes Google AI Studio et Google Cloud Vertex AI. Cette décision stratégique permit aux développeurs du monde entier d’explorer les possibilités offertes par ce nouveau modèle, catalysant ainsi l’innovation dans divers domaines d’application.

L’une des premières et des plus visibles applications de Gemini 1.0 Pro fut son intégration dans le chatbot Bard de Google, rebaptisé plus tard Gemini. Cette implémentation démontra non seulement les capacités conversationnelles impressionnantes du modèle, mais aussi sa flexibilité et son adaptabilité à des interfaces grand public.

La multimodalité de Gemini 1.0 Pro, capable de traiter et de comprendre...

Perplexity : le meilleur pour la recherche

Fondée en 2022 par quatre anciens employés de Google AI - Andy Konwinski, Aravind Srinivas, Denis Yarats et Johnny Ho - cette start-up ambitieuse s’est donnée pour mission de démocratiser l’accès à la connaissance.

Perplexity AI est un moteur de recherche conversationnel innovant qui utilise l’intelligence artificielle pour offrir une expérience de recherche en ligne améliorée. Contrairement aux moteurs de recherche traditionnels, Perplexity AI est conçu pour comprendre le contexte des requêtes des utilisateurs grâce au traitement du langage naturel, ce qui lui permet de fournir des réponses précises et pertinentes sans nécessiter de parcourir de nombreuses pages de résultats.

L’un des principaux atouts de Perplexity AI est sa capacité à documenter ses réponses avec des références externes, ce qui en fait un outil fiable pour la recherche académique et professionnelle. Il s’appuie sur des sources de haute qualité, telles que des études universitaires, pour garantir la crédibilité de l’information fournie. Cette fonctionnalité est particulièrement utile pour valider les informations récentes, chose que font encore mal les autres IA (ChatGPT, Gemini...).

Ci-dessous, une capture d’écran...

Mistral : le chouchou français très efficient

Mistral 7B

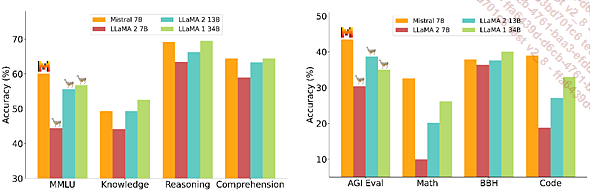

Le 27 septembre 2023, Mistral AI a marqué un tournant dans le domaine de l’intelligence artificielle avec le lancement de Mistral 7B, un modèle de langage qui redéfinit les standards de performance pour sa taille. Avec seulement 7,3 milliards de paramètres, Mistral 7B surpasse des modèles bien plus imposants, notamment Llama 13B sur tous les benchmarks et même Llama 34B sur de nombreux tests. Cette prouesse technique est rendue possible grâce à l’utilisation de technologies innovantes telles que l’attention à requêtes groupées (GQA) pour une inférence plus rapide et l’attention à fenêtre glissante (SWA) pour gérer efficacement de longues séquences.

L’un des aspects les plus remarquables de Mistral 7B est sa polyvalence et son accessibilité. Publié sous licence Apache 2.0, le modèle peut être utilisé sans restriction, ouvrant ainsi la voie à une adoption large et diversifiée dans la communauté de l’IA. Que ce soit pour un déploiement local, sur des plateformes cloud majeures comme AWS, GCP ou Azure, ou via HuggingFace, Mistral 7B offre une flexibilité sans précédent.

Mixtral 8x7B

Ce modèle se distingue par son architecture unique de mélange clairsemé d’experts (Sparse Mixture of Experts ou SMoE), qui lui confère des capacités remarquables tout en optimisant son efficacité.

L’architecture de Mixtral 8x7B est composée de huit experts, chacun comportant 7 milliards de paramètres, d’où son nom « 8x7B ». Cependant, lors de l’inférence, seuls deux experts sont activés à la fois, ce qui permet au modèle de maintenir une empreinte mémoire d’environ 14 milliards de paramètres. Cette approche ingénieuse permet d’obtenir des performances comparables à celles de modèles beaucoup plus volumineux, tout en conservant une efficacité computationnelle élevée.

Les performances de Mixtral 8x7B sont impressionnantes. Il surpasse Llama 2 70B sur la plupart...

Le chat de Mistral devient la meilleure IA gratuite !

Une nouvelle version de LeChat s’avère être très polyvalente en proposant :

-

Canvas, une interface visuelle qui simplifie votre espace de travail. Avec Canvas, les utilisateurs peuvent organiser et réorganiser des éléments de contenu, ajouter des annotations et même demander à Mistral de générer (régénérer) du texte ou des images en fonction du contexte visuel présent.

-

Un accès à l’information tirée d’Internet via la fonctionnalité Recherche web, ce qui permet d’obtenir des informations actualisées et fiables (grâce à la citation des sources).

-

Un outil de génération d’images qui permet à n’importe quel utilisateur de générer des images de qualité seulement à partir d’un simple prompt (meilleur que Dall-E et sans limite) !

Les outils générations d’image et recherche web sont combinables, on peut ainsi illustrer un sujet d’actualité par exemple :

Mistral est actuellement l’un des meilleures choix sur le marché car il offre une utilisation entièrement gratuite et illimitée comparé à ses nombreux concurrents qui, eux, proposent ces fonctionnalités de manière limitée ou partiellement payante.

Claude : le nouveau champion des benchmarks

Claude 3

En mars 2024, Anthropic a dévoilé sa nouvelle génération de modèles d’intelligence artificielle : la famille Claude 3. Cette annonce a marqué une étape importante dans l’évolution des IA génératives, avec trois modèles aux capacités croissantes : Claude 3 Haiku, Claude 3 Sonnet et Claude 3 Opus.

Claude 3 Opus, le modèle le plus avancé, établit de nouveaux standards en matière de performance sur un large éventail de tâches cognitives. À sa sortie, c’est la première fois que le meilleur modèle disponible d’OpenAI se fait dépasser sur des benchmarks d’évaluation courants. Opus excelle notamment dans l’analyse, la prévision, la création de contenu nuancé, la génération de code et la conversation en plusieurs langues.

Claude 3 Sonnet offre un équilibre optimal entre intelligence et vitesse, le rendant particulièrement adapté aux charges de travail d’entreprise. Il est deux fois plus rapide que son prédécesseur tout en offrant des niveaux d’intelligence supérieurs. Sonnet est conçu pour des tâches telles que l’extraction de données, la rédaction de résumés et la création de descriptions de produits.

Claude 3 Haiku est le modèle le plus compact et le plus rapide de la famille, conçu pour fournir des réponses quasi instantanées à des requêtes simples. Il est particulièrement adapté pour des applications nécessitant une réactivité immédiate, comme les chats en direct ou l’auto-complétion.

Tous les modèles Claude 3 bénéficient d’une fenêtre contextuelle de 200 000 tokens...

Le Playground d’OpenAI

Playground est une plateforme web interactive conçue pour permettre aux utilisateurs d’explorer et d’expérimenter avec les modèles de langage d’OpenAI, tels que GPT-3 et GPT-4. Cette interface offre un environnement dynamique où les développeurs, chercheurs et passionnés d’IA peuvent interagir directement avec les modèles et tester différentes fonctionnalités et applications de l’intelligence artificielle.

Pour comprendre pleinement les capacités d’OpenAI Playground, nous devons nous plonger dans ses rouages et ses fonctions afin d’explorer ce qu’il peut faire. De plus, nous verrons une opportunité unique d’éviter la détection d’IA en utilisant divers paramètres disponibles sur la plateforme.

Les nouveaux paramètres

OpenAI Playground s’appuie sur les paramètres de Playground pour permettre aux utilisateurs d’adapter le comportement des modèles d’IA. En jouant avec ces paramètres, vous pouvez affiner la longueur de la réponse, faire de l’ingénierie de prompts et même choisir le niveau d’aléatoire des réponses !

Pour utiliser cette plateforme et parler avec les différents modèles, il faudra charger des crédits avec un minimum de 5$.

Pour mieux comprendre cette plateforme, voici un aperçu rapide de ses paramètres :

Allez sur le site https://platform.openai.com/playground

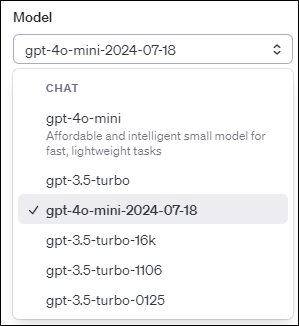

Dans la liste déroulante Model dans le volet de droite, choisissez l’IA à laquelle vous souhaitez parler. Par défaut, GPT-4o est l’option la plus avancée. Cependant, d’autres IA peuvent être moins « intelligentes » mais vous coûte moins cher à usage égal.

Vous pouvez ajuster la longueur des réponses à l’aide du curseur Maximum length. Cette fonction est particulièrement utile lorsque vous avez besoin de réponses plus longues, par exemple pour rédiger une dissertation de 2 000 mots.

Utilisez le réglage de Temperature pour contrôler la part d’aléatoire dans chaque réponse. Des températures plus basses augmentent la probabilité de réponses plus courantes...

Comparatif de toutes ces IA

Ces comparatifs sont un ensemble de faits et d’expériences personnelles à la suite de centaines d’heures passées sur ces IA, vous pourriez ne pas être d’accord, et ce n’est pas grave ! Le but ici est de vous présenter chaque IA sous l’angle où je les utilise et de vous aider à gagner du temps (et de l’argent) dans vos choix d’IA. Ces avis n’engagent que moi.

Pour les individus

Commençons par ChatGPT, équipé du modèle GPT-4o d’OpenAI. Cette combinaison se distingue par sa polyvalence remarquable, particulièrement lorsqu’il s’agit de travailler avec divers types de documents et d’exploiter les ressources de la communauté. Les GPTs personnalisables offrent une grande flexibilité, permettant aux utilisateurs d’adapter l’IA à leurs besoins spécifiques. Si vous désirez analyser des rapports complexes, générer du contenu créatif ou même coder, GPT-4o s’impose comme un choix de premier.

Pour les recherches documentaires et la vérification de faits, Perplexity se démarque nettement. Bien qu’il ne s’agisse pas d’un modèle d’IA à proprement parler, Perplexity utilise intelligemment d’autres modèles comme GPT pour effectuer des recherches en temps réel...

Editions ENI Livres | Vidéos | e-Formations

Editions ENI Livres | Vidéos | e-Formations